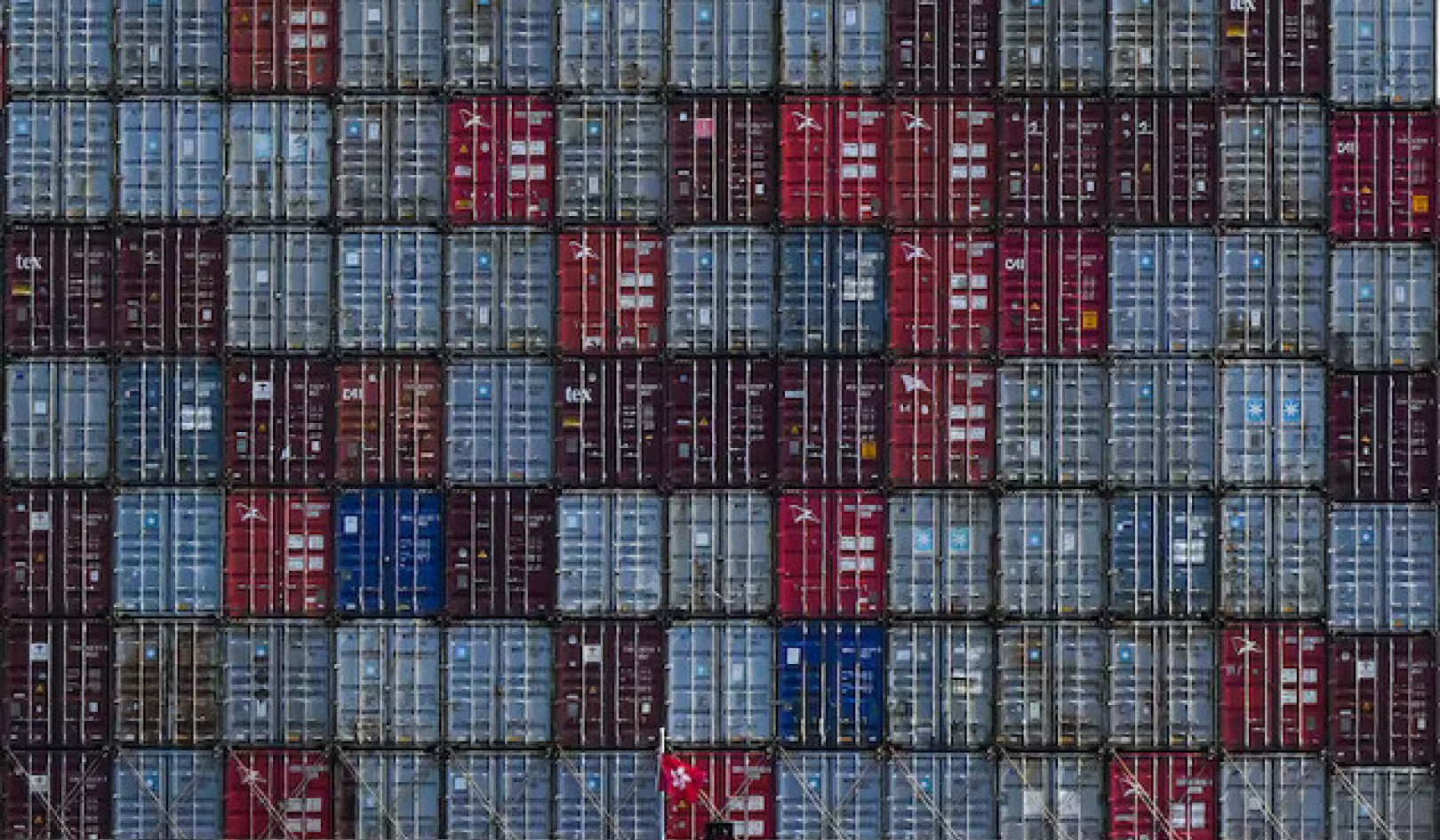

Ved du hvad der sker, når du deler dine data? mtkang / shutterstock.com

Ved du hvad der sker, når du deler dine data? mtkang / shutterstock.com

Hvert aspekt af livet kan styres af kunstige intelligensalgoritmer - fra at vælge hvilken vej, du skal tage til din morgenpendling, til at beslutte, hvem du skal tage på en dato, til komplekse juridiske og retlige forhold som forudsigende politiarbejde.

Store teknologivirksomheder som Google og Facebook bruger AI til at få indsigt i deres gigantiske række detaljerede kundedata. Dette giver dem mulighed for at tjene penge på brugernes kollektive præferencer gennem praksis som mikromålretning, en strategi, der bruges af annoncører til snævert at målrette mod specifikke sæt brugere.

Parallelt stoler mange mennesker nu mere på platforme og algoritmer end deres egne regeringer og samfund. En undersøgelse fra oktober 2018 foreslog, at folk demonstrerede “algoritmevurdering, ”I det omfang de ville stole på rådgivning mere, når de tror, det er fra en algoritme end fra et menneske.

Tidligere har teknologieksperter bekymret sig for en “Digital kløft” mellem dem, der kunne få adgang til computere og internettet og dem, der ikke kunne. Husstande med mindre adgang til digitale teknologier er dårligere stillet i deres evne til at tjene penge og samle færdigheder.

Men som digitale enheder spredes, handler kløften ikke længere kun om adgang. Hvordan håndterer folk overbelastning af information og overflod af algoritmiske beslutninger, der gennemsyrer alle aspekter af deres liv?

De klogere brugere navigerer væk fra enheder og bliver opmærksomme på, hvordan algoritmer påvirker deres liv. I mellemtiden stoler forbrugere, der har mindre information, endnu mere på algoritmer til at styre deres beslutninger.

Skal du forblive forbundet - eller tage stikket ud? pryzmat / shutterstock.com

Skal du forblive forbundet - eller tage stikket ud? pryzmat / shutterstock.com

Den hemmelige sauce bag kunstig intelligens

Hovedårsagen til den nye digitale kløft, efter min mening som en person, der studerer informationssystemer, er, at så få mennesker forstår, hvordan algoritmer fungerer. For et flertal af brugerne ses algoritmer som en sort boks.

AI-algoritmer tager data ind, passer dem til en matematisk model og lægger en forudsigelse, der spænder fra hvilke sange du måske nyder til hvor mange år nogen skal tilbringe i fængsel. Disse modeller er udviklet og tilpasset på baggrund af tidligere data og succesen med tidligere modeller. De fleste mennesker - selv undertiden algoritmedesignerne selv - ved ikke rigtig, hvad der er inde i modellen.

Forskere har længe været bekymret om algoritmisk retfærdighed. For eksempel viste Amazons AI-baserede rekrutteringsværktøj sig at afskedige kvindelige kandidater. Amazons system blev selektivt udpakket implicit kønsord - ord, som mænd er mere tilbøjelige til at bruge i daglig tale, såsom "henrettet" og "fanget".

Andre undersøgelser har vist, at retlige algoritmer er racemæssigt forudindtagede og idømt dårlige sorte tiltalte længere end andre.

Som en del af den for nylig godkendte generelle databeskyttelsesforordning i EU har folk gjort det “En ret til forklaring” af de kriterier, som algoritmer bruger i deres beslutninger. Denne lovgivning behandler processen med algoritmisk beslutningstagning som en opskriftsbog. Tænkningen går ud på, at hvis du forstår opskriften, kan du forstå, hvordan algoritmen påvirker dit liv.

I mellemtiden har nogle AI-forskere presset på for algoritmer, der er det fair, ansvarlig og gennemsigtig, såvel som kan fortolkes, hvilket betyder, at de skal nå deres beslutninger gennem processer, som mennesker kan forstå og stole på.

Hvilken effekt vil gennemsigtighed have? I en undersøgelse, blev elever bedømt af en algoritme og tilbudt forskellige niveauer af forklaring på, hvordan deres jævnaldrende scoringer blev justeret for at komme til en endelig karakter. De studerende med mere gennemsigtige forklaringer stolede faktisk mindre på algoritmen. Dette antyder igen en digital kløft: Algoritmisk bevidsthed fører ikke til mere tillid til systemet.

Men gennemsigtighed er ikke et universalmiddel. Selv når en algoritmes samlede proces er skitseret, detaljerne kan stadig være for komplekse for brugerne at forstå. Gennemsigtighed hjælper kun brugere, der er sofistikerede nok til at forstå algoritmernes indvikling.

For eksempel var Ben Bernanke, den tidligere formand for Federal Reserve, i 2014 oprindeligt nægtet pantfinansiering af et automatiseret system. De fleste enkeltpersoner, der ansøger om en sådan pantfinansiering, forstår ikke, hvordan algoritmer kan bestemme deres kreditværdighed.

Hvad siger algoritmen at gøre i dag? Maria Savenko / shutterstock.com

Hvad siger algoritmen at gøre i dag? Maria Savenko / shutterstock.com

Fravælger det nye informationsøkosystem

Mens algoritmer påvirker så meget af folks liv, er kun en lille brøkdel af deltagerne sofistikerede nok til fuldt ud at engagere sig i hvordan algoritmer påvirker deres liv.

Der er ikke mange statistikker om antallet af mennesker, der er opmærksomme på algoritmer. Undersøgelser har fundet beviser for algoritmisk angst, hvilket fører til en dyb ubalance i magt mellem platforme, der implementerer algoritmer og de brugere, der er afhængige af dem.

En undersøgelse af Facebook-brug fandt ud af, at når deltagerne blev opmærksomme på Facebooks algoritme til kurering af nyhedsfeeds, ændrede ca. 83% af deltagerne deres adfærd for at forsøge at udnytte algoritmen, mens ca. 10% mindskede deres brug af Facebook.

En rapport fra november 2018 fra Pew Research Center fandt ud af, at et bredt flertal af offentligheden havde betydelige bekymringer over brugen af algoritmer til bestemte anvendelser. Det fandt ud af, at 66% mente, at det ikke ville være rimeligt for algoritmer at beregne personlige finansresultater, mens 57% sagde det samme om automatisk genoptagelse af screening.

En lille brøkdel af enkeltpersoner udøver en vis kontrol over, hvordan algoritmer bruger deres personlige data. For eksempel tillader Hu-Manity-platformen brugere en mulighed for at kontrollere, hvor meget af deres data der indsamles. Online encyklopædi Everipedia giver brugerne mulighed for at være en interessent i kurateringsprocessen, hvilket betyder, at brugerne også kan kontrollere, hvordan information aggregeres og præsenteres for dem.

Imidlertid giver langt de fleste platforme hverken en sådan fleksibilitet til deres slutbrugere eller retten til at vælge, hvordan algoritmen bruger deres præferencer til at kurere deres nyhedsfeed eller anbefale dem indhold. Hvis der er valgmuligheder, ved brugerne muligvis ikke om dem. Omkring 74% af Facebooks brugere sagde i en undersøgelse, at de var det ikke klar over, hvordan platformen karakteriserer deres personlige interesser.

Efter min mening bruger den nye digitale læsefærdighed ikke en computer eller er på internettet, men forståelse og evaluering af konsekvenserne af en altid tilsluttet livsstil.

Denne livsstil har en meningsfuld indflydelse på hvordan folk interagerer med andre; på deres evne til være opmærksom på nye oplysninger; og på kompleksiteten af deres beslutningsprocesser.

Stigende algoritmisk angst kan også afspejles ved parallelle skift i økonomien. En lille gruppe individer er fange gevinsterne ved automatisering, mens mange arbejdere er i en usikker position.

Fravalg fra algoritmisk kurering er en luksus - og kunne en dag være et symbol på velstand, der kun er tilgængeligt for nogle få udvalgte. Spørgsmålet er så, hvad de målbare skader vil være for dem på den forkerte side af den digitale kløft.

Om forfatteren

Anjana Susarla, lektor i informationssystemer, Michigan State University

Denne artikel er genudgivet fra The Conversation under en Creative Commons-licens. Læs oprindelige artikel.

Relaterede bøger

at InnerSelf Market og Amazon