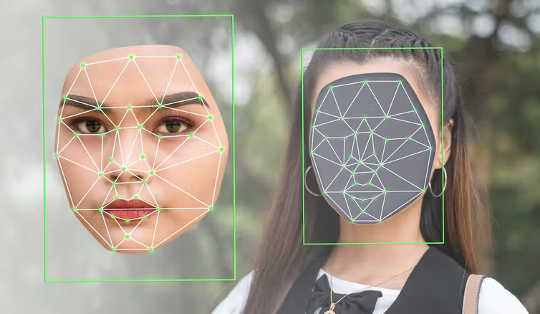

Teknologi, der kan producere deepfakes, er bredt tilgængelig. (Shutterstock)

I begyndelsen af marts, en manipuleret video af den ukrainske præsident Volodymyr Zelenskyy blev cirkuleret. I den fortalte en digitalt genereret Zelenskyy den ukrainske nationale hær om at overgive sig. Videoen blev cirkuleret online, men blev hurtigt afvist som en deepfake - en hyperrealistisk, men alligevel falsk og manipuleret video produceret ved hjælp af kunstig intelligens.

Mens russisk desinformation ser ud til at have en begrænset effekt, illustrerede dette alarmerende eksempel de potentielle konsekvenser af deepfakes.

Deepfakes bliver dog brugt med succes i hjælpeteknologi. For eksempel, mennesker, der lider af Parkinsons sygdom, kan bruge stemmekloning til at kommunikere.

Deepfakes bruges i undervisningen: Det irlandsbaserede talesyntesefirma CereProc skabte en syntetisk stemme til John F. Kennedy, bringe ham tilbage til livet for at holde sin historiske tale.

Alligevel har hver mønt to sider. Deepfakes kan være hyperrealistiske, og dybest set uopdagelige af menneskelige øjne.

Derfor kunne den samme stemmekloningsteknologi bruges til phishing, bagvaskelse og afpresning. Når deepfakes bevidst bruges til at omforme den offentlige mening, anspore til sociale konflikter og manipulere valg, har de potentialet til at underminere demokratiet.

Forskere ved University of Washington producerede en deepfake af Barack Obama.

Skader kaos

Deepfakes er baseret på teknologi kendt som generative adversarial netværk hvor to algoritmer træner hinanden til at producere billeder.

Selvom teknologien bag dybe forfalskninger kan lyde kompliceret, er det en simpel sag at fremstille en. Der er talrige online applikationer som f.eks Ansigtsudveksling , ZAO Deepswap der kan producere deepfakes inden for få minutter.

Google Colaboratory – et online lager for kode på flere programmeringssprog – indeholder eksempler på kode, der kan bruges til at generere falske billeder og videoer. Med software, der er så tilgængeligt, er det nemt at se, hvordan gennemsnitlige brugere kunne skabe kaos med deepfakes uden at indse de potentielle sikkerhedsrisici.

Populariteten af apps til ansigtsbytte og onlinetjenester som f.eks Dyb nostalgi vise, hvor hurtigt og bredt deepfakes kunne blive adopteret af den brede offentlighed. I 2019, ca. 15,000 videoer med deepfakes blev opdaget. Og dette tal forventes at stige.

Deepfakes er det perfekte værktøj til desinformationskampagner, fordi de producerer troværdige falske nyheder, der tager tid at afsløre. I mellemtiden er skaderne forårsaget af deepfakes - især dem, der påvirker folks omdømme - ofte langvarige og irreversible.

DeepSwap er et godt valg for alle, der ønsker at skabe overbevisende deepfakes med minimal indsats. ??t;a href="https://twitter.com/hashtag/DeepSwap?src=hash&ref_src=twsrc%5Etfw">#DeepSwap #FaceSwap #DeepFake #FaceApp #Reface #Anmeldelse #Anmeldelser #Kunstig intelligens #AI #Tech #Teknologi #TechNews #Teknologinyheder #MENA #TechMGZNhttps://t.co/A2Cbp02sH1

— Tech Magazine (@TechMGZN) Maj 4, 2022

Er det at se tro?

Den måske farligste forgrening af deepfakes er, hvordan de egner sig til desinformation i politiske kampagner.

Vi så dette, da Donald Trump udpegede enhver lidet flatterende mediedækning som "falske nyheder." Ved at anklage sine kritikere for at cirkulere falske nyheder, var Trump i stand til at bruge misinformation til forsvar for sine forseelser og som et propagandaværktøj.

Trumps strategi giver ham mulighed for at bevare støtten i et miljø fyldt med mistillid og desinformation ved at påstå "at sande begivenheder og historier er falske nyheder eller deepfakes".

Troværdigheden i myndigheder og medier undermineres, hvilket skaber et klima af mistillid. Og med den stigende udbredelse af deepfakes, kunne politikere nemt nægte skyld i eventuelle nye skandaler. Hvordan kan en persons identitet i en video bekræftes, hvis de benægter det?

At bekæmpe desinformation har dog altid været en udfordring for demokratier, da de forsøger at opretholde ytringsfriheden. Human-AI-partnerskaber kan hjælpe med at håndtere den stigende risiko for deepfakes ved at få folk til at verificere oplysninger. Det kunne også overvejes at indføre ny lovgivning eller anvende eksisterende love for at straffe producenter af deepfakes for at forfalske oplysninger og udgive sig for personer.

Multidisciplinære tilgange fra internationale og nationale regeringer, private virksomheder og andre organisationer er alle afgørende for at beskytte demokratiske samfund mod falsk information.![]()

Om forfatteren

Sze-Fung Lee, forskningsassistent, Institut for Informationsvidenskab, McGill University , Benjamin CM Fung, professor og Canada Research Chair i Data Mining for Cybersecurity, McGill University

Denne artikel er genudgivet fra The Conversation under en Creative Commons-licens. Læs oprindelige artikel.