Sikker på, at din AI-assistent kan bestille en aftale for dig, men hvad med enhver meningsfuld samtale? Shutterstock / Bas Nastassia

Sikker på, at din AI-assistent kan bestille en aftale for dig, men hvad med enhver meningsfuld samtale? Shutterstock / Bas Nastassia

Google for nylig afsløret dens seneste talende AI, kaldet Duplex. Duplex lyder som en rigtig person, komplet med pauser, "umms" og "ahhs".

Teknologigiganten siger, at det kan tale med folk i telefonen for at foretage aftaler og kontrollere forretningens åbningstider.

I optagede samtaler, der blev spillet ved Google-afsløringen, talte det problemfrit med menneskerne i den modtagende ende, der syntes totalt uvidende om, at de ikke talte med en anden person.

Disse opkald forlod teknologiorienteret publikum på Google viser gispende og jublende. I et eksempel forstod AI endda, hvornår den person, det talte med, blandede sig og var i stand til at fortsætte med at følge samtalen og reagere passende, når det blev fortalt, at det ikke behøvede at foretage en reservation.

Fremkomsten af AI-assistenterne

Hvis du har brugt nogen af de aktuelt tilgængelige stemmeassistenter, f.eks Google Home, Apples Siri eller Amazon Echo, denne fleksibilitet kan overraske dig. Disse assistenter er notorisk vanskelig at bruge til andet end standardanmodningerne, såsom at ringe til en kontakt, afspille en sang, foretage en simpel websøgning eller indstille en påmindelse.

Når vi taler til disse nuværende generations assistenter, er vi altid opmærksomme på, at vi taler med en AI, og vi skræddersyr ofte det, vi siger, på en måde, som vi håber maksimerer vores chancer for at få det til at fungere.

Men de mennesker, der talte med Duplex, anede ikke. De tøvede, vendte tilbage, sprang ord over og ændrede endda fakta halvvejs gennem en sætning. Duplex savnede ikke et slag. Det syntes virkelig at forstå, hvad der foregik.

Læs mere: Smarte højttalere kan være vendepunktet for hjemmeautomatisering

Så er fremtiden ankommet tidligere end nogen havde forventet? Er verden ved at være fuld af online (og telefoniske) AI-assistenter, der chatter lykkeligt og gør alt for os? Eller værre, vil vi pludselig være omgivet af intelligente AI'er med deres egne tanker og ideer, der måske eller ikke inkluderer os mennesker?

Svaret er et bestemt "nej". For at forstå hvorfor hjælper det med at kigge hurtigt under emhætten på, hvad der driver en AI som denne.

Duplex: hvordan det fungerer

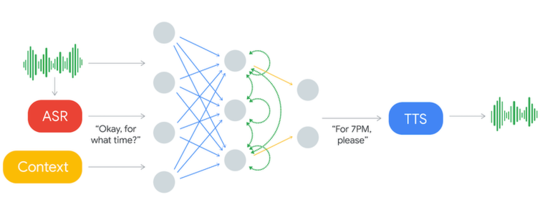

Dette er hvad Duplex AI-system ligner.

Indgående lyd behandles via et ASR-system. Dette producerer tekst, der analyseres med kontekstdata og andre input for at producere en svartekst, der læses højt gennem tekst-til-tale-systemet (TTS). Google

Indgående lyd behandles via et ASR-system. Dette producerer tekst, der analyseres med kontekstdata og andre input for at producere en svartekst, der læses højt gennem tekst-til-tale-systemet (TTS). Google

Systemet tager "input" (vist til venstre), som er stemmen til den person, det taler med, i telefonen. Stemmen går gennem automatisk talegenkendelse (ASR) og konverteres til tekst (skrevne ord). ASR er i sig selv et avanceret AI-system, men af en type, der allerede er i almindelig brug i eksisterende stemmeassistenter.

Teksten scannes derefter for at bestemme hvilken sætningstype den er (såsom en hilsen, en erklæring, et spørgsmål eller en instruktion) og udtrække vigtige oplysninger. Nøgleoplysningerne bliver derefter en del af konteksten, som er ekstra input, der holder systemet opdateret med det, der hidtil er blevet sagt i samtalen.

Teksten fra ASR og Context sendes derefter til hjertet af Duplex, som kaldes et kunstigt neuralt netværk (ANN).

I diagrammet ovenfor er ANN vist med cirklerne og linjerne, der forbinder dem. ANN'er er løst modelleret på vores hjerner, som har milliarder af neuroner forbundet til enorme netværk.

Ikke helt en hjerne endnu

ANN'er er dog meget enklere end vores hjerner. Det eneste, denne prøver, er at matche inputordene med et passende svar. ANN lærer ved at få vist udskrifter af tusinder af samtaler mellem mennesker, der foretager reservationer til restauranter.

Med nok eksempler lærer det, hvilke slags input sætninger man kan forvente af den person, det taler med, og hvilke slags svar man skal give til hver enkelt.

Tekstsvaret, som ANN genererer, sendes derefter til en tekst-til-tale-synthesizer (TTS), som konverterer det til talte ord, som derefter afspilles til personen på telefonen.

Endnu en gang er denne TTS-synthesizer en avanceret AI - i dette tilfælde er den mere avanceret end den på din telefon, fordi den næsten ikke skelnes fra enhver normal stemme.

Det er alt der er ved det. På trods af at det er state-of-the-art, er hjertet i systemet egentlig kun en teksttilpasningsproces. Men du kan spørge - hvis det er så simpelt, hvorfor kunne vi ikke gøre det før?

Et lært svar

Faktum er, at menneskets sprog og de fleste andre ting i den virkelige verden er for variable og uordnede til at kunne håndteres godt af normale computere, men denne slags problemer er perfekte til AI.

Bemærk, at output produceret af AI afhænger helt af de samtaler, det blev vist, mens det lærte.

Det betyder, at forskellige AI'er skal trænes i at foretage bookinger af forskellige typer - så kan f.eks. En AI bestille restauranter og en anden kan reservere håraftaler.

Dette er nødvendigt, fordi typerne af spørgsmål og svar kan variere så meget for forskellige typer reservationer. Dette er også, hvordan Duplex kan være så meget bedre end de generelle stemmeassistenter, som har brug for at håndtere mange typer anmodninger.

Så nu skal det være tydeligt, at vi ikke kommer til at have afslappede samtaler med vores AI-assistenter snart. Faktisk er alle vores nuværende AI'er ikke andet end mønstermatchere (i dette tilfælde matchende tekstmønstre). De forstår ikke, hvad de hører, eller hvad de ser på, eller hvad de siger.

Mønstertilpasning er en ting, vores hjerner gør, men de gør også meget mere. Nøglen til at skabe mere kraftfuld AI kan være at låse op for flere af hjernens hemmeligheder. Vil vi? Nå, det er det endnu et spørgsmål.![]()

Om forfatteren

Peter Stratton, postdoktor, University of Queensland

Denne artikel er genudgivet fra The Conversation under en Creative Commons-licens. Læs oprindelige artikel.